哎,说到这几个月搞AI应用,真是一把辛酸泪啊。不知道大伙儿有没有这感觉?就是那种——明明手里捏着一把大模型的API Key,OpenAI的、Claude的、还有国产那几个顶呱呱的,但真要做点东西出来,

上个月我就特崩溃。做个个人助手吧,想让它在不同模型间自动切换,便宜的模型处理日常唠嗑,贵的模型用来写代码。结果呢?代码写得跟蜘蛛网似的,这边要兼容OpenAI的格式,那边又要处理Anthropic的接口,一个没弄好,整个服务就挂了。我那老搭档还损我,说我这不叫写代码,叫“在API的雷区里蹦迪”。我当时就想,

后来我一琢磨,干脆自己动手,丰衣足食。我就去扒拉了一大堆开源的

原来“代理”不只是个传话筒,简直是给AI请了个大管家

我以前一直觉得,代理嘛,不就是个转发请求的二道贩子?用了那些源码自己搭了一遍才明白,这玩意儿的水深着呢。

我第一个搭起来试水的,是一个叫 AISBF 的项目-1。这名字挺唬人,但说白了,它就是个“交通警察”。我在配置文件里把好几个厂商的Key都扔进去,然后告诉它规则:比如“如果问的是普通问题,就走便宜的通道;要是写代码,就给Claude;要是分析图片,就给Gemini。”这玩意儿自己就能根据内容去选模型,还能做负载均衡-1。我特别喜欢它的一个功能是自动故障转移。有一次OpenAI那会儿正好抽风,接口超时,我这心里还咯噔一下,结果人家AISBF二话不说,自动就把请求切到备用的 Anthropic 上去了,用户那边压根没感觉到卡顿。这要搁我自己写逻辑,光重试机制和错误捕捉就得写几百行。

还有一点特别解决我的痛点,就是速率限制和计费。以前我总担心,要是哪个熊孩子写了个死循环,或者程序被攻击了,是不是一晚上就能把我的API额度给刷爆?在那些成熟的ai api代理源码里,比如我后来看到的 ai-router 或者 llm-proxy-server,都内置了特别精细的限流功能-7-8。你可以设置每分钟多少个请求,甚至每天多少额度。我之前有个开源项目丢在GitHub上,老被人拿去免费嫖我的Key,现在好了,我直接在代理层限制每个Key每天最多花1块钱,超过就自动拒绝,钱包算是安全了-7。

从“能用”到“好用”,就差这一层封装

其实,真正让我觉得“哎哟,不错哦”的,是这些代理源码带来的格式统一能力。你知道的,各家大厂的API返回格式都长得不一样,OpenAI是一种,Claude是另一种,本地的Llama又是奇葩的一种。如果你的代码直接对接它们,那简直是噩梦。

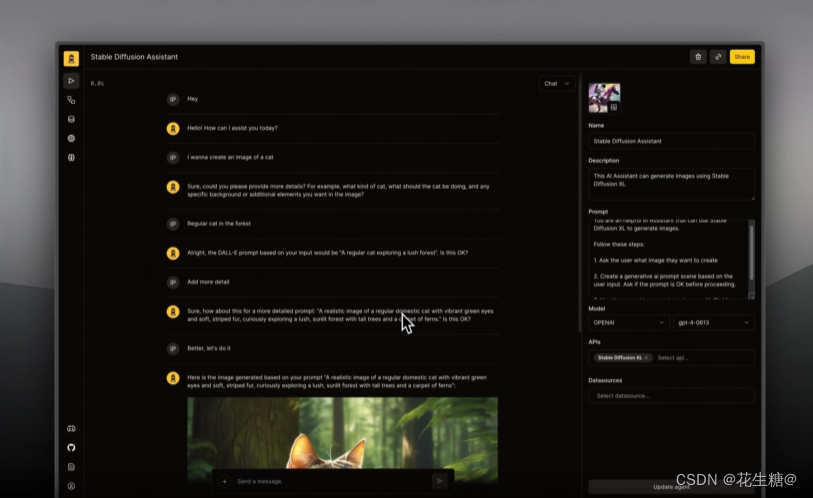

但是我找到的这个 llm-proxy-server 就很巧妙-8。它在中间层做了一层转换,把所有厂商的返回都“打扮”成OpenAI的格式。这意味着什么?意味着我的业务代码从此只认识一种“语言”——OpenAI的标准。我想换模型?简单,在代理的配置文件里改一行字就行,业务代码完全不用动。这种解耦的感觉,对于一个有点代码洁癖的人来说,简直不要太爽-8。

我现在本地跑了好几个服务,都是用的同一个代理入口。有的走官方的GPT-4,有的走便宜点的DeepSeek,甚至还有一个接入了本地的 Ollama 跑小模型-8。在外人看来,我就好像开了个“模型超市”,想用哪个点哪个,而且对业务代码完全透明。这种感觉,就好像你虽然只买了一辆车的钱,但因为有了个万能挂车,拉人拉货甚至下地干活,都能干。

说句老实话,门槛还是有的,但乐趣更多

不过我也得吐槽一下,这些东西对小白确实不太友好。那天我让我一朋友也试试,他看了半天文档,问我:“我这Node.js环境都装了半天了,怎么还没跑起来?”我当时就乐了,想起自己当初折腾的时候,也是连Git clone都要百度一下是什么意思-4。但话说回来,正因为有点门槛,玩起来才有成就感嘛。

而且,现在有些项目已经开始做可视化配置了,甚至有的可以直接一键部署到云服务器上-4。像我这种懒人,现在最常用的方法就是直接买个便宜的轻量应用服务器,上去敲几行命令,一个24小时在线的AI网关就跑起来了-4。不管是上班路上,还是躺在家里,我都能通过这个统一的入口调各种各样的模型,甚至还能把它接驳到微信或者飞书里,给同事们当个免费的小助手。

折腾这些“ai api代理源码”的经历,让我最大的感受就是:工具真的能重塑人的工作流。 以前我是被API厂商“绑架”的,他们改个版、停个服务,我就得跟着屁股后面改代码。现在呢?我把主动权抓在了自己手里。这个代理就像个“技术防火墙”,把所有的复杂性和不确定性都挡在了外面,留给我的,只有一个干净、统一、可控的接口。

我看到后台有不少朋友留言问问题,今天正好挑几个典型的,咱们好好唠唠。

网友“代码写不动的老张”问:

“看你写得挺热闹,但这玩意儿对普通程序员来说,学习成本高不高?我除了Python啥都不会,能搞吗?”

我的回答:

老张,咱俩情况差不多,我也就会点Python皮毛。你放心,现在的项目文档都写得挺“喂饭”的了。像你如果主要用Python,我强烈推荐你去看看那个 llm-proxy-server-8。它安装就一句话 pip install llm-proxy-server 的事儿。装完了,核心就是编辑一个 config.toml 文件。你把它想象成填表就行:

“connections”那块儿,就是把你的各种API Key填进去,像填快递单一样。

“routing”那块儿,就是写规则,比如

“gpt” = “openai.”,意思就是所有名字带gpt的模型,都去openai那个连接里找。

根本不用写逻辑代码,改完配置,命令行敲个llm-proxy-server就跑起来了。然后你的Python代码里,只要把OpenAI库的base_url改成http://localhost:8000/v1,API Key换成你在代理里设置的虚拟Key,其他代码照旧-8。你说,这是不是比你之前自己写if…else…判断调用哪个API要简单一百倍?绝对的一杯咖啡时间,生产力工具鸟枪换炮。

网友“新仔小白鼠”问:

“大佬,我就想自己玩玩,不想花钱买那些收费的API Key,有没有免费的方案啊?”

我的回答:

嘿,兄弟,你问到点子上了!现在的开源生态,早就把“免费”玩出花了。很多代理源码本身就支持接入本地模型。比如那个AISBF,它明确写了支持 Ollama-1。Ollama知道吧?那就是个本地跑模型的神器。你在自己电脑上装个Ollama,拉个 llama3 或者 qwen 这种免费的开源模型下来,然后在代理的配置文件里把Ollama加进去。这不就齐活了?

另外,像阿里云这些大厂,有时候会给新手送免费额度。在刚才我发的那个阿里云的教程里,它提到了可以配置 阿里云百炼的免费模型API-4。你完全可以这么玩:日常的闲聊、信息总结这种不太费劲的任务,就路由到本地的免费小模型去跑;万一遇到需要动脑筋的复杂逻辑,或者写代码,再让它走那些付费的、但质量高的云端Key。代理就是你的“智能调度员”,帮你精打细算。免费和付费混搭着用,既满足了折腾的快感,又保住了钱包,这才是咱们玩技术的精髓啊!

网友“TeamLeader有点烦”问:

“我们团队现在好几个项目,每人手里都捏着一堆Key,管理混乱不说,月底报销对账都对不清楚。用这个能解决吗?”

我的回答:

兄弟,你这是典型的“幸福的烦恼”啊,团队发展到一定规模都会遇到。我跟你说,用代理源码来解决这个问题,简直是降维打击。你把代理服务器架在公司的内网或者云上一台小机器上,所有人都只认这一个入口。这样有几个天大的好处:

第一,安全管理。大家的程序里不用再硬编码Key了,只配置代理的地址和一个虚拟Key。真正值钱的厂商Key,只掌握在运维或者负责人的手里,存在代理服务器的环境变量里-8。就算哪个实习生电脑丢了,泄露的也只是一个能随时吊销的虚拟Key,核心资产保住了。

第二,成本控制与审计。你看那个 llm-proxy-server 的文档里,甚至有 Logger 的配置-8。这意味着什么?意味着所有经过代理的请求,都可以被完整地记录下来:谁(哪个虚拟Key)在什么时候,调用了哪个模型,花了多少tokens,耗时多久,全都有日志。月底财务要报表?直接把日志导出来一分析,每个项目、每个人用了多少钱,清清楚楚,再也不用凭感觉拍脑袋了。

第三,资源共享。团队里可能有的项目需要大上下文,有的需要快响应。你可以在代理层配置多个厂商的Key,大家共享池子。再也不用出现“A项目OpenAI额度不够用了,B项目那边还剩几个亿token在睡大觉”的尴尬局面了。这就是团队协作的终极形态啊!