当大模型还在比拼千亿参数时,AI行业已悄悄按下“效率革命”的启动键——mini ai 助手正以1/10的成本实现大模型80%的核心能力-7。对于开发者而言,这不仅是技术趋势,更是必须掌握的核心知识模块。

一、痛点切入:为什么需要mini ai助手?

先看一个典型的“调用大模型API”的传统实现:

import openaidef ask_gpt4(question): response = openai.ChatCompletion.create( model="gpt-4", messages=[{"role": "user", "content": question}], temperature=0.7, max_tokens=2048 ) return response.choices[0].message.content

这段代码看似简洁,背后却隐藏着三个致命痛点:

成本高昂:调用一次GPT-4 API的成本足够买一杯咖啡-7。对于需要高频调用的业务场景(如客服机器人、实时对话系统),每月API费用轻松突破数万元。

响应延迟:复杂任务的推理延迟超过10秒-7。在代码调试、实时交互等毫秒级响应的场景中,每等1秒都是煎熬。

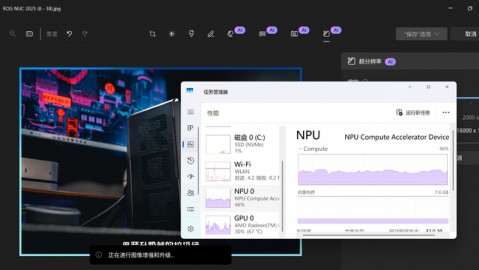

部署门槛高:大模型动辄需要数十GB显存和强大算力,无法部署在手机、IoT设备等边缘计算环境中-2。

正是这些痛点,催生了mini ai助手的诞生。它并非大模型的“阉割版”,而是在特定场景下对性能、成本和效率进行精准权衡的产物-2。

二、核心概念讲解:什么是mini ai助手?

标准定义:Mini AI Assistant(微型人工智能助手),指通过模型压缩技术实现轻量化部署的AI系统,其参数量通常控制在千万到十亿级别,能够在资源受限环境中提供高效、低延迟的智能服务。

场景化类比:如果把大模型比作“全能教授”(知识渊博但成本高、反应慢),那么mini ai助手就是“领域专家助理”——在特定任务上同样精通,但反应更快、成本更低、随叫随到。

核心价值体现在四个维度:

| 价值维度 | 说明 |

|---|---|

| 移动与边缘计算 | 可在智能手机、IoT设备上流畅运行,实现离线或低延迟智能交互 |

| 成本控制 | 显著降低推理成本,使AI应用具备商业可行性 |

| 响应速度 | 毫秒级响应,满足实时对话、游戏NPC等场景需求 |

| 隐私与安全 | 完全部署在本地,避免敏感数据上传云端 |

三、关联概念讲解:知识蒸馏 vs 量化 vs 剪枝

实现一个mini ai助手,核心技术“三板斧”缺一不可-2:

1. 知识蒸馏——最核心的思想

定义:用一个庞大的“教师模型”教导一个结构更简单的“学生模型”。学生模型不仅学习标准答案,更要学习教师模型输出的“软标签”(概率分布),这包含了类别间的相似性信息-2。

作用:让学生模型用更少的参数学到更泛化的能力,保留大模型的核心能力。

2. 量化——最直接的空间压缩

定义:将模型权重和激活值的精度从32位浮点数降至8位整数。

效果:模型大小减少约4倍,内存带宽需求大幅降低,推理速度显著提升-2。

3. 剪枝——最精细的冗余消除

定义:移除模型中“不重要”的参数,例如将权重矩阵中接近零的值置零,或直接移除整个神经元/注意力头-2。

特点:剪枝后模型更小更快,但需要重新训练或微调以恢复精度。

四、概念关系总结

三者是互补组合关系,而非替代关系。典型策略是:先蒸馏 → 再量化 → 最后剪枝-2。

一句话记忆:知识蒸馏负责“教得精”,量化负责“存得小”,剪枝负责“去得净”,三者协同打造“小而强”的mini ai助手。

五、代码示例:用100行代码构建最小智能体

以下是一个极简mini ai助手的核心代码框架,仅用约100行代码实现基本的智能体循环-18:

Mini AI Agent 核心实现 import litellm class MiniAIAssistant: """极简AI助手实现 - 核心仅30行代码""" def __init__(self, model_name="gpt-3.5-turbo"): self.model_name = model_name self.messages = [] def add_message(self, role, content): """添加对话消息""" self.messages.append({"role": role, "content": content}) def query(self, user_input): """调用大模型获取回复""" self.add_message("user", user_input) 调用大模型API response = litellm.completion( model=self.model_name, messages=self.messages, temperature=0.7 ) assistant_reply = response.choices[0].message.content self.add_message("assistant", assistant_reply) return assistant_reply 使用示例 agent = MiniAIAssistant() reply = agent.query("帮我总结一下轻量级AI助手的核心技术") print(reply)

核心流程拆解:

感知阶段:接收用户输入 → 存储到消息列表

决策阶段:调用LLM进行推理 → 生成回复

行动阶段:返回生成的回复内容

这个极简设计背后,是普林斯顿和斯坦福团队对AI编程助手的重新思考——当大语言模型足够强大时,100行核心代码就足以实现一个可工作的智能体-24。

六、底层原理与技术支撑

mini ai助手的强大能力依赖以下底层技术栈:

| 技术点 | 作用说明 |

|---|---|

| Transformer架构精简 | 大幅减少层数(如32层→12层)和隐藏层维度(4096→1024),直接减少参数量-2 |

| 分组查询注意力 | 在几乎不影响效果的情况下减少Key-Value缓存的内存占用 |

| KV Cache优化 | 缓存过去的Key和Value张量,避免重复计算,提升生成速度-2 |

| 紧凑词汇表 | 使用SentencePiece BPE等技术,平衡编码效率和模型大小-2 |

这些底层优化共同确保mini ai助手能够在资源受限的环境中高效运行。

七、高频面试题与参考答案

Q1:轻量级AI助手和大语言模型(LLM)有什么区别?

参考答案:LLM是“全能教授”,参数量通常在百亿到千亿级,知识广博但成本高、延迟大。mini ai助手是“领域专家助理”,参数量在千万到十亿级,通过知识蒸馏、量化、剪枝等压缩技术在特定场景下实现大模型80%的能力,同时将成本控制在1/5以下、延迟降低2倍以上-7。

Q2:实现一个mini ai助手主要有哪些技术手段?各自的优缺点是什么?

参考答案:主要有三种手段——知识蒸馏、量化和剪枝。蒸馏保留语义能力最好,但需要教师模型训练;量化压缩最直接(大小减少4倍),但可能损失精度;剪枝去除冗余参数最精细,但需要重训练恢复精度。实际工程中通常组合使用-2。

Q3:mini ai助手适合哪些应用场景?

参考答案:四个核心场景——移动/边缘计算(手机、IoT设备)、高频实时交互(客服机器人、代码助手)、成本敏感型业务(创业项目原型验证)、隐私合规场景(本地部署、数据不外传)-2。

Q4:100行代码能实现一个AI智能体吗?原理是什么?

参考答案:可以。核心在于遵循“感知-决策-行动”循环,利用大模型作为决策引擎。100行代码足以实现基础的对话管理和工具调用逻辑。mini-swe-agent等开源项目已验证了这一可行性,在SWE-bench测试中达到65%的问题解决率-24-18。

八、结尾总结

回顾全文核心要点:

✅ 概念:mini ai助手是轻量级AI系统,在千万到十亿参数量级实现高效智能服务

✅ 技术:知识蒸馏、量化、剪枝“三板斧”协同打造

✅ 代码:100行核心代码即可实现可工作的智能体

✅ 面试:重点掌握概念辨析、技术手段对比和场景分析

重点提示:mini ai助手≠大模型阉割版,而是针对特定场景的精准优化产物。面试中切忌混淆“小模型”与“弱模型”,要强调其在成本、延迟、部署便利性上的核心优势。