最近后台好多朋友问我同一个问题:“国内ai代理服务器排名到底哪家强?我踩坑踩得都快成筛子了。”

说真的,我太懂这种感受了。去年这时候我也是个小白,看着网上五花八门的推荐,脑袋嗡嗡的。什么API2D、CloseAI、OpenAI-SB,名字一个比一个高大上,结果真掏钱用了,要么卡得要命,要么用着用着突然就404了,关键是还死贵。

那会儿我就琢磨,这东西水也太深了吧?后来我自己做了个小项目,天天跟这些代理打交道,踩过的坑能绕地球一圈。今天我就把这一年多摸爬滚打出来的经验掏心窝子跟你聊聊,顺便整理一份我觉得比较靠谱的国内ai代理服务器排名清单。咱不整那些虚头巴脑的,就说人话。

第一类选手:AI API中转服务,到底该选谁?

先说最普遍的需求,就是咱们开发者想调GPT、Claude这些大模型的API。国内直连不了,必须得找中转。市面上做这事儿的一大堆,但质量嘛,真的是一言难尽。

老牌选手现状:

API2D算是元老级了,早期确实好用,但现在你再用会发现,价格比官方贵了30%到50%不说,高峰期还经常超时,而且只支持GPT,你要用Claude还得再找一家-1。

CloseAI名字起得挺讨巧,但稳定性最近下滑得厉害,网上吐槽的帖子一抓一大把-1。

OpenAI-SB走的是低价路线,但低价往往意味着高风险。我有个朋友贪便宜用了它,项目跑到一半,服务商直接跑路了,API Key全废,差点没把他气出高血压-1。

那么问题来了,有没有更稳的方案?

我跟你说,2026年再盯着这些单纯的中转服务,就有点过时了。现在更流行的玩法是模型聚合平台。这玩意儿啥意思?就是一个API,能同时调GPT、Claude、DeepSeek、Gemini,而且自动做故障转移——一个模型挂了,自动切到另一个,你的代码一行都不用改-1。

Ofox.ai在这方面做得不错。你用它的API,base_url换一下,其他代码原封不动。最关键是价格按官方走,不加那层莫名其妙的溢价-1。你说香不香?

第二类选手:搞数据采集,隧道代理才是王道

咱们聊国内ai代理服务器排名,不能光说API调用,还得照顾另一波人——搞数据采集的兄弟们。

如果你是做爬虫的,肯定遇到过这种情况:本地跑得好好的,一上线就凉凉。为啥?因为IP被封了。

很多人第一反应是用VPN,但这玩意儿真不适合干这个。VPN设计出来是给人上网的,不是给机器爬数据的。它的IP池太小,而且都是数据中心IP,反爬系统一眼就能认出来-4。

那咋办?得用隧道代理。

隧道代理实测数据:

我最近看了份2026年3月的实测报告,里面测了3家主流隧道代理服务商,数据挺有参考价值的。

站大爷的表现最稳,24小时连接成功率99.2%,晚高峰可用率95.8%,全国覆盖300多个地区,故障自愈速度不到30秒-2。这意味着啥?你的采集任务7×24小时跑,基本不用担心断连。它唯一的“缺点”是单价略高,但对于企业级采集来说,这点差价换来的稳定性,值了。

另外两家表现就差些了。服务商X晚高峰可用率只有82.5%,故障自愈要5分钟以上,偶尔大面积断连-2。服务商Y更惨,全国只覆盖20个省市,晚高峰可用率78.9%,想采集全国数据基本没戏-2。

所以在这份国内ai代理服务器排名里,如果你是搞大规模数据采集的,我的建议是直接冲站大爷。别只看IP池大小,可用率才是保命的关键-2。

第三类选手:自建方案,适合愿意折腾的人

如果你不想用第三方服务,或者数据隐私要求特别高,那可以考虑自建方案。

用腾讯云轻量服务器搭个代理层,成本其实挺低的。有人实测过,买个香港节点(月35元),装个Hysteria2或Shadowsocks-rust做透明代理,然后把ChatGPT Plus、Claude、Midjourney这些工具全部走这个代理,月总费用能压到80元以内-8。

这个方案的好处是IP环境统一,不容易被风控。坏处是得自己折腾,而且模型调用还是得对接官方API,费用另算。

还有种更硬核的方案是用LiteLLM自托管代理。它是开源的,部署在你的服务器上,自己管理各个提供商的API Key-10。这适合那些公司有企业协议、有特殊定价的团队。不过运维成本不低,需要盯着监控、处理故障、更新配置-10。

到底怎么选?看你的场景

聊完这些,你会发现国内ai代理服务器排名其实没有绝对的“第一”,关键看你要干啥。

如果你是开发AI应用:

追求省心省事,直接上模型聚合平台,比如Ofox.ai,一个API搞定所有模型,自动故障转移-1

想控制数据隐私,可以自托管LiteLLM,自己管服务器和API Key-10

预算有限但愿意折腾,可以考虑用腾讯云自建代理层-8

如果你是搞数据采集:

大规模采集,选隧道代理,站大爷这类实测数据好的-2

临时小项目,普通动态代理也能用,但别指望它稳定-2

如果你是个人玩玩:

选那些免费额度够用、支付方便的服务,先试再买

写在最后

说到底,选代理这事儿就跟找对象似的,没有最好的,只有最合适的。别光看广告,得看疗效。我给你的国内ai代理服务器排名只是参考,真决定之前,建议自己去试一下——大部分服务都有免费试用,跑个24小时看看晚高峰表现,比啥测评都管用。

好了,该说的都说了,下面让几个“老司机”来跟你们唠唠他们的困惑。

网友“代码小白”: 我就是个个人开发者,平时偶尔调调API玩,不想花太多钱,但也不想被坑。像我这种情况,选哪种代理最划算?有没有那种免费额度够用、又不会突然跑路的?

答: 嘿兄弟,你这情况我太熟了。个人开发者嘛,谁的钱都不是大风刮来的。我的建议是分两步走:

第一步,先用免费额度试水。很多模型聚合平台都有免费试用额度,比如Ofox.ai这种,注册就送一些Token,够你跑几十次了。你就拿你最常用的几个场景去测,看看响应速度、稳定性,别光测白天,晚上七八点也试试,那才是真实水平-1。

第二步,选那些按量付费、没有月费的服务。千万别上来就充大几百,除非你确定天天用。个人开发者的需求往往是脉冲式的,今天写个脚本调几十次,下个月可能就闲着。这时候那些月费制的服务就很亏了。

具体到产品,我个人觉得API2D这种老牌虽然贵点,但至少不会第二天就跑路,适合求稳-1。Ofox.ai这种新平台性价比更高,但你要是不放心,可以先少充点钱用着观察-1。至于那些低价得离谱的,建议直接跳过——便宜有便宜的道理,你的项目数据不值得为那点差价冒险。

还有个小技巧:如果你只是偶尔用用,可以考虑用腾讯云轻量服务器自建代理层,月付35块,然后把ChatGPT Plus这类服务通过它访问,成本能控制得比较低-8。当然这需要一点动手能力,适合喜欢折腾的。

网友“数据老王”: 兄弟,我这边是做电商数据采集的,每天要跑百万级的数据。最头疼的就是封IP,换了N家代理了,白天跑得好好的,一到晚上七八点就崩。你说的晚高峰测试能不能再具体点?到底该怎么测才算靠谱?

答: 老王,你这问题问到我心坎里了。搞采集的,谁没被晚高峰坑过?你说的那种“白天稳如狗,晚上崩成狗”的现象,我太懂了。

咱们来拆解一下,怎么测才靠谱。网上一堆测评看IP池大小、看价格,那些都是虚的。真正的硬指标就两个:24小时连接成功率和晚高峰可用率-2。

具体怎么测?我给你个实操指南:

第一,选个普通工作日,别选周末。晚上19:00到23:00是晚高峰核心时段,你要跑至少连续72小时,别只跑一天,因为不同日子流量不一样-2。

第二,用你自己的真实采集脚本,别用人家给的测试用例。50线程并发起,因为规模化采集通常都是高并发的-2。单线程跑得再稳也没用,一上并发就露馅。

第三,重点关注这三个数值:24小时成功率低于95%的直接Pass;晚高峰可用率低于90%的别用于核心业务;故障自愈速度超过2分钟的要慎重-2。

我帮你解读一下实测数据:站大爷能做到24小时成功率99.2%、晚高峰95.8%、故障自愈<30秒,这意味着啥?意味着你的采集任务基本不用人盯着,它自己就能扛住流量高峰-2。另外两家一个82.5%一个78.9%的晚高峰可用率,说白了就是一到晚上就有超过两成的请求失败,你如果靠这个吃饭,那损失可大了去了-2。

对了,还有一点千万注意:别用普通动态代理手动维护IP池。规模化采集必须用隧道代理,让服务商帮你搞定IP调度,否则光切换IP就能把你累死-2。

网友“AI发烧友”: 我之前一直用API2D,但最近总感觉速度慢,而且只能调GPT,想试试Claude还得换一家。你说的那种一个API调多个模型的聚合平台真的靠谱吗?会不会有安全风险?代码迁移麻不麻烦?

答: 这位朋友,你说的“一个平台调所有模型”这事儿,2026年已经不是新鲜玩意儿了。我跟你说说我自己的真实体验。

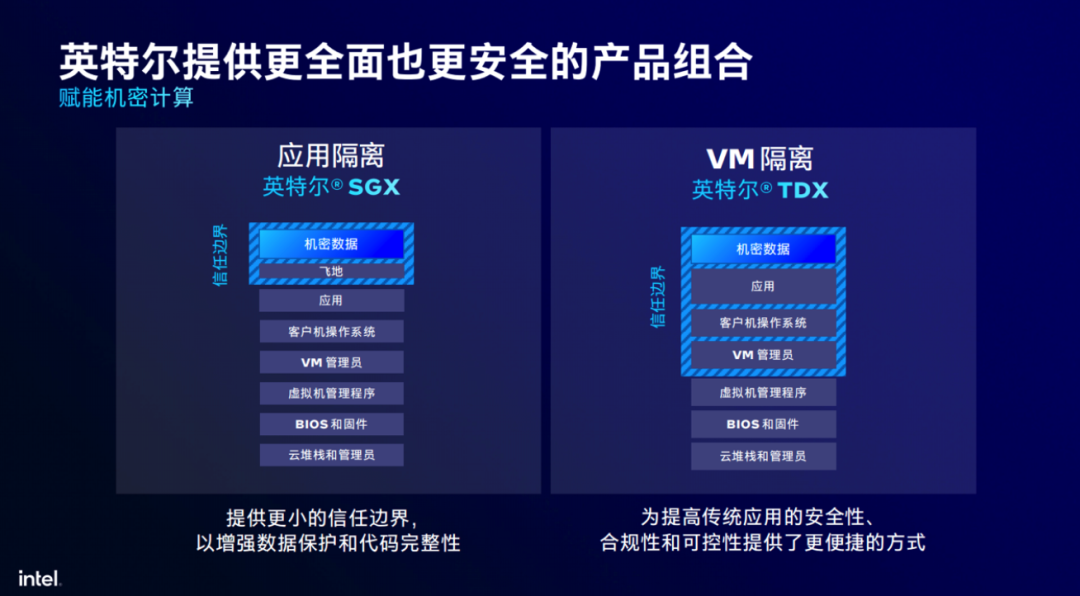

先回答你最关心的安全性问题。这事儿得分两面看。如果你用的是模型聚合平台,你的API Key和请求数据确实会经过他们的服务器。正规平台会有数据加密和隐私保护机制,但如果你做的是金融、医疗这类对数据隐私要求极高的项目,那还是自托管更稳妥-10。

不过对于大部分开发者和中小企业来说,聚合平台的风险其实是可控的。像Ofox.ai这类正规商业运作的平台,比那些灰色地带的中转服务靠谱得多-1。而且你想啊,你用一个API Key管所有模型,总比到处注册、到处充钱要安全吧?至少少了一半泄露风险。

再说代码迁移。这一点我必须给个大大的赞。我当初从API2D切到Ofox.ai,代码改了一行——base_url换了,其他原封不动-1。你之前用OpenAI SDK写的所有代码,直接复用,连参数都不用改。想调Claude?把model字段从“gpt-4”改成“claude-3-5-sonnet”就行,同一个client,不用重新初始化-1。

最后说性能。很多人担心加一层网关会不会增加延迟。实测数据表明,托管网关的延迟通常在50-150ms之间,自托管LiteLLM在5-20ms之间-10。对大部分应用来说,这点差异感知不到。而且托管网关有边缘节点,全球用户都能就近访问,在某些场景下反而更快-10。

所以我给你的建议是:先用起来,把API Key换过去跑一周,感受一下速度和稳定性。如果觉得没问题,直接切;如果实在不放心数据走第三方,再用自托管方案。没必要因为担心而把自己困在一个功能受限的服务上——毕竟2026年了,只用一个模型,真的不够用了。