知言ai助手(英文:Zhiyan AI Assistant)是一款集成了自然语言处理与深度学习技术的智能助手,能够理解并响应用户的各种需求,包括信息查询、文本创作与数据分析等-。在AI应用全面爆发的2026年,这类AI助手已从单纯的对话机器人进化为具备记忆、推理与任务执行能力的智能体-。大量学习者仍停留在“会用但不懂原理”的层面——会写提示词,却说不出背后的NLP机制;能操作多轮对话,却不理解上下文窗口如何管理。本文将从一个传统痛点切入,带你看清技术全貌,并通过代码示例与高频面试题,帮你建立完整的知识链路。

一、痛点切入:只会用却说不清原理

假设你正在开发一个用户评论情感分析模块。传统做法如下:

传统硬编码方式:针对每种情感类型写if-elsedef analyze_sentiment(text): if "好" in text or "棒" in text: return "positive" elif "差" in text or "烂" in text: return "negative" else: return "neutral" 问题:需要人工维护关键词库,覆盖面有限,误判率高

这种方式的缺点显而易见:

扩展性差:每新增一种情感表达,都要手动扩充关键词

准确率低:无法处理“这款产品不算好”这种双重否定逻辑

语言覆盖有限:处理不了网络新词或不同语境下的语义变化

正是为了解决这些问题,基于深度学习的NLP技术应运而生——让机器从海量数据中自动学习语义特征,而非依赖人工规则。

二、核心概念讲解:自然语言处理(NLP)

标准定义:自然语言处理(Natural Language Processing,NLP)是人工智能与语言学交叉的前沿领域,旨在让计算机能够理解、解析、生成并处理人类自然语言。

拆解关键词:

自然语言:区别于编程语言的日常交流语言,如中文、英文

处理:包括理解(听懂你说什么)、生成(写出符合语法的回答)、分析(提取关键信息)

生活化类比:NLP之于AI助手,就像“耳朵+大脑”之于人类。耳朵负责接收声音信号,大脑负责将声波解码成语义、理解意图、组织回复。知言ai助手的NLP模块,正是在执行这套“听懂—理解—回应”的流程。

核心价值:NLP让机器具备了与人类对话的能力,是AI助手一切交互功能的技术基石。没有NLP,智能助手只能像计算器一样执行死板指令,无法实现真正的“智能对话”。

三、关联概念讲解:深度学习(Deep Learning)

标准定义:深度学习(Deep Learning,DL)是机器学习的一个子领域,通过构建含多个隐藏层的人工神经网络,从海量数据中自动学习特征表示与模式规律。

与NLP的关系:深度学习是NLP的核心实现手段。早期的NLP依赖人工标注规则和统计模型,而深度学习通过端到端的训练方式,让模型自己“学会”语言的语法、语义和上下文关系。

关键差异对比:

| 对比维度 | 传统NLP方法 | 基于深度学习的NLP方法 |

|---|---|---|

| 特征提取 | 人工设计规则 | 模型自动学习 |

| 上下文理解 | 窗口有限 | 全局依赖建模(如Transformer) |

| 泛化能力 | 弱 | 强 |

| 适用场景 | 规则明确的领域 | 开放域对话、情感分析等 |

运行机制示例:以知言ai助手的文本分类功能为例,深度学习模型通过以下步骤工作:输入文本 → 分词 → 词嵌入(Word Embedding)→ 多层神经网络 → Softmax输出分类结果-。整个过程无需人工设定任何分类规则。

四、概念关系与区别总结

一句话概括:NLP是“做什么”的目标定义,深度学习是“怎么做”的技术路径——NLP定义问题,深度学习提供解决方案。

现代AI助手的智能问答、文本创作、情感分析等功能,都依赖深度学习作为底层引擎来驱动NLP任务的执行-。记住这个逻辑:目标导向(NLP)+ 技术落地(DL)= 智能交互能力。

五、代码示例:模拟知言AI助手的API调用

以下示例模拟了通过RESTful API调用大模型进行文本生成的过程,帮助你理解开发者如何将AI能力集成到应用中-:

import requests import json 模拟知言AI助手的API调用 API_URL = "https://api.zhiyanai.com/v1/chat/completions" API_KEY = "your_api_key_here" def chat_with_ai(prompt): headers = { "Authorization": f"Bearer {API_KEY}", "Content-Type": "application/json" } 构造请求体 payload = { "model": "zhiyan-v1", "messages": [ {"role": "user", "content": prompt} ], "temperature": 0.7, 控制输出随机性 "max_tokens": 500 限制输出长度 } response = requests.post(API_URL, headers=headers, json=payload) if response.status_code == 200: return response.json()["choices"][0]["message"]["content"] else: return f"Error: {response.status_code}" 调用示例 user_input = "请帮我总结一下2026年AI行业的发展趋势" response = chat_with_ai(user_input) print(f"知言AI回答:{response}")

执行流程说明:

客户端发送HTTP POST请求,携带用户输入的prompt

服务端验证API密钥,解析请求参数

大模型处理输入,生成回复内容

服务端封装响应返回给客户端

客户端解析并展示结果

六、底层原理/技术支撑

知言ai助手这类智能产品的底层能力,主要依赖以下核心技术模块:

大语言模型(LLM) :基于Transformer架构,通过海量文本预训练,具备数十亿到数千亿参数,这是智能对话的“大脑”-

语义交互框架:通过自然语言查询、语义检索等智能化手段,实现精准理解用户意图-

云端计算架构:将用户、开发者与互联网资源以高度智能化的方式连接,提供“所想即所得”的体验-

技术层级关系:

底层:Transformer架构 → 支撑大规模预训练

中层:大语言模型 → 提供通用语言能力

上层:应用层(问答、创作、分析) → 面向用户的具体功能

了解这些底层技术,能帮你更好地理解AI助手的工作原理,也为深入源码分析和模型调优打下基础。

七、高频面试题与参考答案

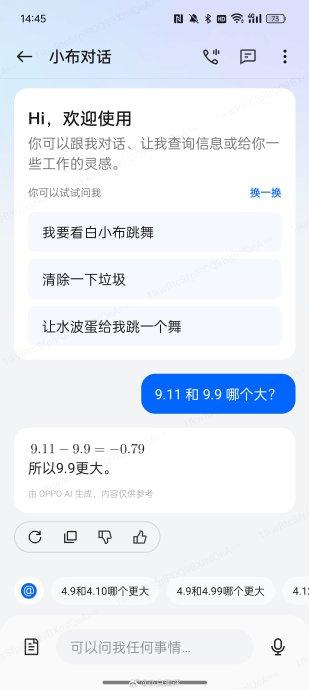

面试题1:请简述NLP在AI助手中的应用场景

参考答案:NLP(Natural Language Processing,自然语言处理)在AI助手中主要有三类应用场景:信息查询(如天气查询、知识问答)、文本创作(如文章撰写、文案生成)和数据分析(如情感分析、关键词提取)。以知言AI助手为例,它通过NLP技术理解用户意图并生成相应回答,实现了从“能对话”到“会思考”的跨越-。

踩分点:术语全称 + 场景分类 + 举例说明

面试题2:Transformer架构相比RNN/LSTM的主要优势是什么?

参考答案:Transformer相比RNN/LSTM的优势主要体现在三点:并行计算——自注意力机制可同时处理序列中的所有位置,而非逐词递推,训练效率大幅提升;长距离依赖建模——通过全局注意力捕获任意距离的语义关联,解决了RNN的梯度消失问题;可扩展性——通过堆叠注意力层实现模型规模扩展,为大语言模型提供了工程基础。这也是当前主流大模型普遍采用Transformer架构的核心原因。

踩分点:并行性 + 长距离依赖 + 可扩展性

面试题3:什么是RAG?如何提升AI助手的回答准确性?

参考答案:RAG(Retrieval-Augmented Generation,检索增强生成)是一种将外部知识库检索与生成模型相结合的技术框架。其工作原理分为三步:首先根据用户问题从知识库中检索相关文档片段,然后将检索结果与原始问题拼接后输入大模型,最后由模型生成基于检索知识的回答。相比纯生成模型,RAG能有效降低“幻觉”问题,保证答案的时效性和准确性,是目前企业级AI助手的标准架构方案之一。

踩分点:全称释义 + 三步流程 + 价值说明

面试题4:大语言模型的上下文窗口为何重要?

参考答案:上下文窗口(Context Window)指模型一次能处理的文本最大长度,单位通常为Token。其重要性体现在:窗口越大,模型单次能“记住”的对话历史和文档信息就越多,多轮对话的连贯性和长文档分析能力就越强。以行业标杆为例,部分先进模型已支持1M甚至2M Token的上下文窗口,意味着可以一次性处理整本《三体》三部曲级别的长文本,这对复杂任务的连续执行至关重要。

踩分点:定义 + 场景价值 + 行业数据

面试题5:AI Agent与传统对话机器人有何本质区别?

参考答案:核心区别在于是否具备自主规划与执行能力。传统对话机器人仅限于“理解输入—生成输出”的问答闭环,无法主动调用外部工具或执行多步任务。而AI Agent具备:任务分解能力(将复杂目标拆解为可执行步骤)、工具调用能力(如查询API、操作数据库)、记忆与反思能力(从历史交互中学习优化)。简言之,传统机器人是“回答问题”,AI Agent是“完成任务”。这也是2026年AI产业从“万能助手”转向“系统集成”的核心驱动力-。

踩分点:能力对比 + 三大特征 + 行业趋势

八、结尾总结

回顾全文,我们共同完成了以下知识链路:

| 阶段 | 核心内容 | 掌握要点 |

|---|---|---|

| 痛点分析 | 传统规则方法的局限性 | 理解“为什么需要AI” |

| 核心概念 | NLP的定义与价值 | 牢记“听懂—理解—回应” |

| 关联概念 | 深度学习的作用 | 区分目标与技术手段 |

| 代码示例 | API调用流程 | 理解前后端交互逻辑 |

| 底层原理 | Transformer与云端架构 | 建立技术层级认知 |

| 面试考点 | 5道高频题 | 背诵标准答案结构 |

重点提醒:面试时最容易混淆NLP和深度学习的关系——记住“NLP是问题,深度学习是解法”,自然能答得清晰。本文聚焦AI助手的核心技术与应用,下一篇我们将深入RAG检索增强生成的具体实现,敬请关注。